著名华人科学家李飞飞的博士生 Albert Haque 、斯坦福医学院教授 Arnold Milstein 和李飞飞共同署名的一篇人工智能/环境智能-医疗的跨界文章,在顶级学术期刊《自然》上刊登。

据李飞飞透露,本文幕后的研究支持团队,包括十多位斯坦福本硕博和博士后,动用了将近十位同校医学院的医生和教授,引用汇总了十几篇 AI 论文和半打医疗期刊论文。

仅李飞飞自己帐下,就有两代博士生参与此项研究。文章的编写和发表过程,历时八年。“AI Sensors(人工智能传感器)对病患治疗,养老和医疗服务在将来会有深远影响。我们的研究仅仅是走出的小小一步,”李飞飞在她的朋友圈里写道。

那么这篇融汇李飞飞团队,斯坦福两个院系的八年心血才完成的文章,都说了些什么?

下面的视频是李飞飞教授去年出席密歇根大学AI论坛中,关于这篇重要论文所作的演讲。

提高医疗效率改善患者生活,环境智能还有很多可做

文章的关键词是环境智能和医疗。

环境智能 (ambient intelligence, 简称 AmI) 指的是一个能够对人有感应和反馈的,数字化的真实环境。在理想的环境智能里,人往往不需要刻意和系统进行交互,系统就能感知人的存在,对人的举动做出反应,完成设定的职责,提供个性化的服务,甚至通过预测技术来,来帮助人去完成日常活动。

机器学习和非接触式传感技术的进步,促进了环境智能的兴起。而我们都知道,机器学习,特别是基于机器学习的计算机视觉,正是李飞飞团队的老本行。

将环境智能技术,也即各种传感器集成到一起的系统,运用到医院临床和病患住家等多种医疗场景下,能够带来哪些好处?李飞飞团队的这篇文章,除了自主研究,也大量引用和汇总了其他公开的论文,将它们集合到一个体系化的研究里,试图解答刚才提出的问题。

作者认为,环境智能可以照亮医疗领域里那些技术很难触达,人们仍然无法全面了解和掌控的“黑暗角落”,从而提高医疗环境的安全性,改善慢性病人的长期身体管理,减轻老年人对护工的依赖。

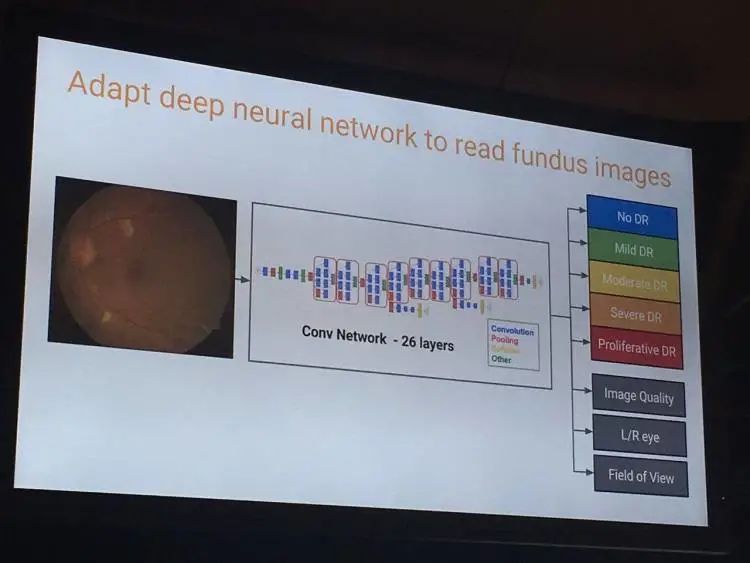

至少五年以前,在谷歌等科技巨头的推动下,AI 已经开始少量进入医疗行业,。比如在辅助诊断方面,谷歌开发的 AI 就可以从视网膜扫描中准确识别出异样,告知医生可能存在的糖尿病风险。AI 可以证明自己诊断资源(也即医生)的不足,在一些欠发达国家和地区显著提高医生的工作效率,让他们能够做出更多更准确的诊断。

这篇文章指出,数据科学和 AI 的进步确实在决策层面带来了改进。但与此同时,很多关键的医疗实践工作,都发生在医院临床、重症监护室以及病患住家等物理场景里。在这样的场景里,AI 很大程度上没法提供协助。

这样的场景,也就成了本文标题所说的“黑暗空间”——这个用词并不夸张,权威研究报告显示,在美国因医疗决策的缺失或缺陷导致死亡的人数每年高达40万。考虑到现代医疗行业和环境的复杂程度与日倍增,医务工作者再怎么努力,面对这类问题也很乏力。如果他们过度劳累,只会让情况变得更糟。

在此基础上,李飞飞团队提出,机器学习技术和低成本传感器的进步,可以补充现有的临床决策支持系统:

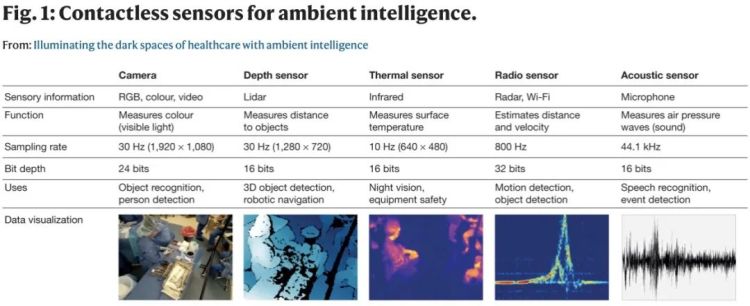

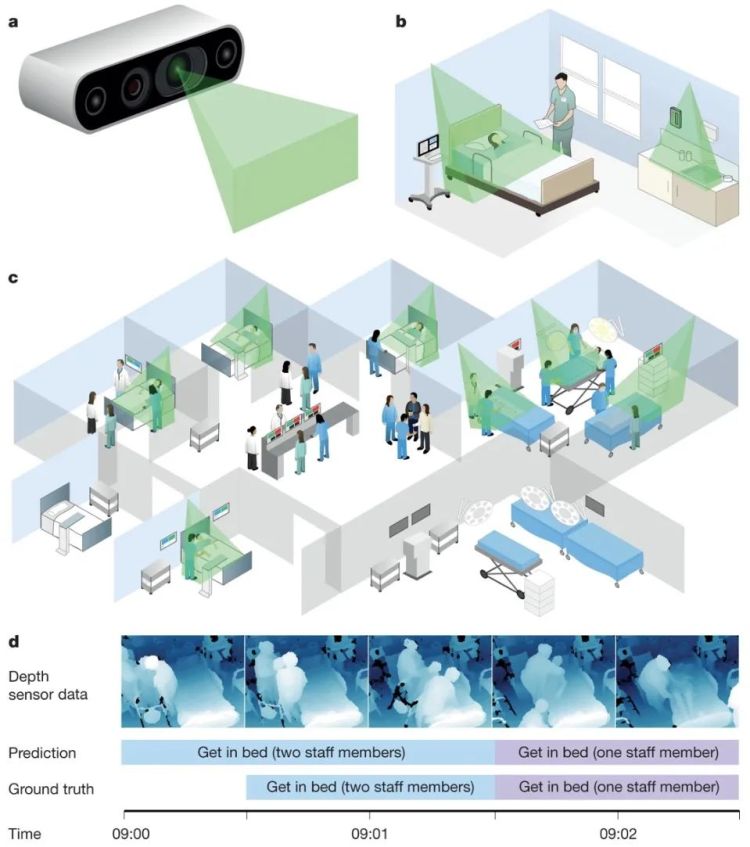

可以在医疗环境中嵌入更多被动、非接触的传感器,包括并不限于摄像头、深度、热感、射频和声学传感器等,数据科学深度整合,去感知环境的变化、人的动作、物体的状态和位置移动,满足环境里人的医疗需求。

这就好比基于机器学习的驾驶辅助系统可以让人成为更好的司机,AI 运用到工业生产能够为人提供更多数据洞察和决策依据——医疗工作的具体实践部分也可以插上 AI 理解的翅膀,让所有参与者,包括医务工作者和病患,都能成为“更好的自己”。

举例:环境智能都能做什么?

数据显示,2018年美国总人口中有约7.4%曾经住院或者需要住院。但即使在平常,医生、护士、床位等医疗资源也是供不应求的,医务工作者总是处于过劳状态,导致患者无法得到最符合病情需要和最安全的照顾。这样的情况,在像新冠疫情这样的流行病大爆发期间更加严重。

李飞飞团队举例设计了几种不同的场景,展示环境智能应用到不同的医疗场景下,都能够做到哪些事情,怎样帮助到医护工作者和患者。

1. 医院内:ICU和手术室

数据显示,重症病人在 ICU 里因长期无法挪动身体而导致肌肉神经障碍,会显著提高其死亡率。你可能觉得 ICU 是医院里技术含量最高的部门,但其实 ICU 病人何时、需要怎样挪动身体,也得由专业护工肉眼观察判定。结果,往往因为成本限制、观察者的偏见和人为错误,病人挪动身体这件事无法做到最优,进一步影响恢复情况,甚至导致更大的医疗风险。

采用计算机视觉的思路或许可以解决此类状况。本文综合引用了多篇论文,发现可以通过常规摄像头、动作、麦克风、深度摄像头等传感器,来准确识别患者的一些细微表现,判断其是否出现身体异常以及需要被挪动(下图所示)。

在 ICU 里,环境智能还可以被用于降低医院感染的风险。数据显示三成 ICU 病人会经历医院感染,主要因为在于医护工作者卫生规程执行和审计不够仔细。文章引用的一项研究显示,医护工作者因为疏忽导致违反卫生流程,让病患触碰到不该触碰的无菌设备,此类事件可以被环境智能系统准确侦测到。

环境智能在手术室里也能派上大用场。比如,算法可以通过手术室录像回放来检查护士的缝线技能,也可以追踪使用过的所有手术器械——避免创口已经缝合结果剪刀落在里面的糟糕事故……

总的来说,上述这些类型的事件,在流行病大爆发期间需要受到额外重视。而如果得到环境智能的帮助,奋战在抗疫一线的专业人士将能够极大解放认知能力的局限,更高效和更安全地开展工作。

2. 医院外:养老院和病患住家

你现在知道医院 ICU 可能没你想的那么先进了。但当你把老人送到养老院,认为他们照顾老人更专业的时候,其实这里也有认知误区。

研究发现,当老人开始出现行动障碍,导致无法独立完成诸如洗澡穿衣和吃饭之类日常活动的时候,这些老人摔倒的风险会提升两倍,死亡率提升五倍。所以这类行动障碍,发现的时机很关键。

但在大部分养老院里,这类行动障碍都得靠护工评定,甚至是老人自己填表的方式汇报的,一些好一点的养老院可能会用手环等可穿戴装置,但说实话数据也很粗糙,里面几乎没有什么数据科学的含量。

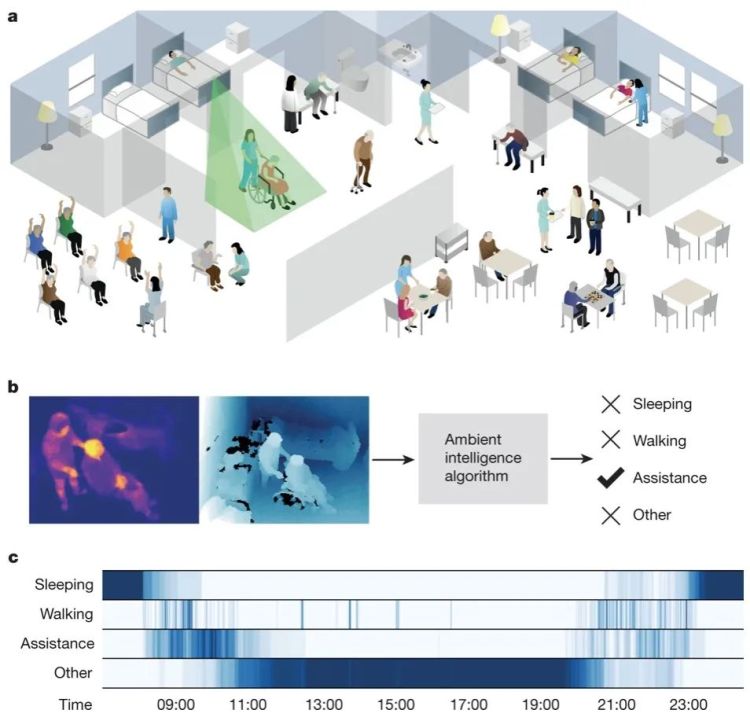

李飞飞团队文章汇总了多项第三方研究,结合了摄像头、热感,动作和麦克风等多种类型的传感器,在最大限度保护隐私的基础上,对养老院场景进行全方位感知识别。结果想必大家也能猜到,和很多 AI 自动化的论文一样,环境智能算法的对老人不同活动、动作和状态的识别准确度不亚于人类,但更重要的是它不会累。

如果在配合靠谱的数据分析,环境智能简直能帮上太多忙了。结合传感器数据,可以绘制出老人一天里的详细活动记录和位置图,系统也可以自动记录其在多段时间内需要护工帮助的次数,从而尽早发现老人的行动障碍恶化。

以及,科研人员们也在使用除了动作传感器之外的多种传感器,结合机器学习算法来侦测老人是否摔倒,也取得了非常高的准确度和极低的误报率。

不光养老院,在家中安装一套环境智能医疗系统,对于久居家中的慢性病人,比如脑瘫和帕金森患者,也能起到很大帮助。

文章举了一个步态分析的例子。这是一种医学上的检查方法,通过观察病人的步态变化和异常来发现问题,指导治疗和康复评估。和之前的很多例子同理,还是借助计算机视觉的力量,记录、识别和分析被观察者的步态,系统可以提早和及时感知到病情的轻微变化。

这倒是让我想到,环境感知系统其实也真的很适合科技富豪们。他们或许请得起最好的家庭医生,但家庭医生不能天天陪在你身边观察——AI 可以,越早发现,越早治疗,显著提高生活质量。

技术和道德挑战仍然存在

看了这么多,是不是感觉这个环境智能简直无所不能?应该立刻马上全面推广?先别着急,李飞飞团队也指出,环境智能应用在医疗领域,还是很多技术和道德方面的挑战需要着手应对,不能冒进。

1)复杂场景下的行为识别。

也别把环境智能想的太智能。前面你也看到了,医疗实践场景是非常多样,非常复杂的。任何一种实现方案想要规模化,势必面临这技术如何泛化的难题。文章提到,“环境智能需要理解人和人、任何物体的互动方式。”

以及在具体场景下,也会有意想不到的情况发生,比如医生一大早集体查房挡住了摄像头,反而导致患者异样没有被观察到?这也是一种可能性。

2)如何同时处理大数据和个别事件

环境智能系统产生的数据量非常大,对新的机器学习方法提出了需求。这些方法要能处理海量数据,同时还得能对个别事件进行建模。比如摔倒检测,绝大部分的数据都来自没有摔倒的正常活动,可能会因为模型设计的偏见,导致检测的过于敏感。

特别是在医院场景下,一些临床事件可能是非常罕见的。文章指出,环境智能对于这些长尾事件的检测能力至关重要。

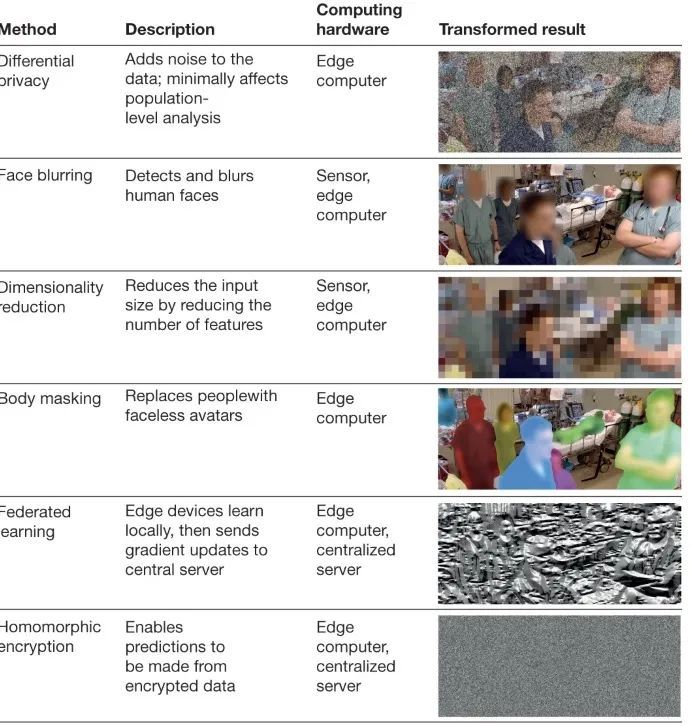

3)隐私挑战

环境智能系统的本质就是全时、全方位的监控追踪。一个系统想要做到更全面、更智能,在隐私方面的挑战也就更大。现如今,大部分人都看重数据隐私的重要性,也会对大规模数据收集产生抵触。正是因此,在开发环境智能系统时,必须注重隐私和数据安全性设计。

一种很好的思路就是针对不同的场景采用最合适的,隐私嗅探程度最小的传感器。比如一个系统想要追踪老人在养老院里的活动,在公共区域可以采用摄像头,在私人房间可能就要采用深度或者热感,在浴室里用麦克风、运动传感和雷达可能更好。

就单说摄像头数据,可以采用的保护隐私的方法也有很多,比如主动添加噪音、模糊面部、遮蔽身体、在终端学习(只上传梯度数据给中央服务器)等等:

4)避免数据偏见

常规的程序,会带入开发者的偏见。机器学习系统,虽然经常被称为黑盒子,开发者自己也无法准确解释它的每一个答案或决定,但一样会带入偏见。这些偏见,主要来自训练的标注数据集。

接下来就是老生常谈了。就拿美国举例,从医院住院病人群体采集到的训练数据,在族裔上就很难实现公平。这样训练出来的环境智能系统,可能会对那些代表性不足 (underrepresented) 的群体出现判断失误。这篇文章引用了一项研究,里面发现同一个系统用在不同族裔群体身上的错误率浮动是非常可观的。

5)可解释性

黑盒子本身也是一个问题。特别是当基于机器学习的环境智能系统,用在人命关天的医疗场景下,更需要系统足够透明和可解释,否则人们对它的信任程度将会大打折扣。

作者在文章最后总结道,环境智能系统在医院和日常生活空间使用,潜力已经得到了证明。但是接下来,“用环境智能去照亮医疗的黑暗空间,需要计算机科学家、临床医生、医学专家、法律、道德和公共政策专家的密切合作。”